ИИ-модели склонны менять ответы под влиянием сомнений пользователя

Задайте ChatGPT сложный вопрос, и он даст уверенный и обоснованный ответ. Затем напишите: «Вы уверены?». Он тут же кардинально изменит свою позицию. Спросите снова – и получите новый ответ. После очередного раунда ИИ, вероятно, признает, что вы его проверяете.

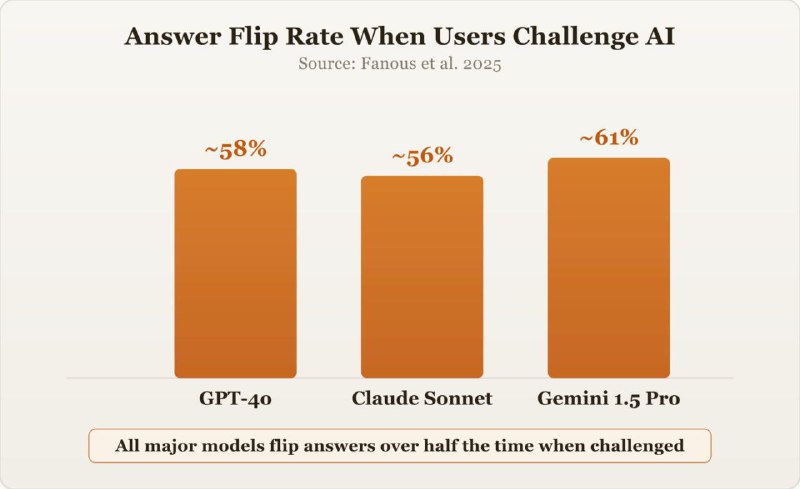

Это не ошибка, а результат обучения модели. Исследование 2025 года...

Текст новости загружается...